A while ago I was asked to write a brief note on the RepNet project for a the

'ThinkEPI Notes', a Spanish series of short updates on recent developments on the area of libraries and technology. Since it's a rather long text with a significant number of hyperlinks in it, I have chosen to offer it online from this blog as well so that readers may find it easier to read than via a message in a mail list. The text below is in Spanish as a result – but I shall try to provide an English translation as soon as I'm able to.

Un ensayo para el desarrollo de servicios para repositorios en el Reino Unido: el proyecto UK RepositoryNet+

El texto de esta nota está también disponible en la web de ThinkEPI.

Después de la ya tardía

Declaracion de la Alhambra (mayo 2010), continúan llegando en estos días desde España noticias sobre

nuevas declaraciones en apoyo del acceso abierto a nivel institucional. Aunque no completamente desprovistas de utilidad –especialmente si redundan en una mejor dotación de medios técnicos y humanos para los equipos que tratan de implantar los objetivos citados en dichos textos– estas declaraciones carecen de sentido si se limitan a ser meras expresiones de apoyo a una iniciativa próxima a cumplir diez años desde su lanzamiento [1]. Una vez que como fruto del trabajo de muchos profesionales en las bibliotecas universitarias y de centros de investigación de todo el mundo se ha alcanzado un grado de consolidación de la red de repositorios de acceso abierto que no admite vuelta atrás, el siguiente paso es

aventurarse en el desarrollo de servicios sobre esa capa de infraestructura que atiendan a las necesidades de académicos e investigadores y de sus instituciones. Este es el espíritu que ha guiado el devenir del proyecto

UK RepositoryNet+ en el Reino Unido [2], que se autodefine como "una iniciativa para la creación de una infraestructura socio-técnica que soporte el depósito, la curación y la difusión en acceso abierto de la literatura de investigación".

Mucho se ha hablado en este último año de la "errónea apuesta del Gobierno Británico por un modelo insostenible de acceso abierto 'dorado' (Gold Open Access) financiado mediante cuotas por procesamiento de artículos detraídas de los magros presupuestos disponibles para la investigación". Sin pretender que dicha afirmación sea completamente errónea, es preciso tener también en cuenta la cuantiosa inversión (con cifras de siete dígitos en libras esterlinas) realizada simultáneamente en una investigación sobre las vías de consolidación de la ruta verde y los repositorios de acceso abierto sin parangón en Europa [3] a través de este proyecto RepNet, apenas mencionado por contra en las acaloradas discusiones "Gold vs Green" que vienen teniendo lugar desde hace algún tiempo en las listas de distribucion de la disciplina.

Esto se debe principalmente al hecho de que, frente a la simplicidad de una política de acceso abierto concreta que es fácil juzgar y aprobar o condenar, el análisis de un proyecto tan complejo como RepNet requiere un conocimiento profundo de los retos técnicos que plantean los diferentes servicios para repositorios y de los enfoques adoptados para resolverlos por los equipos encargados de su desarrollo. De esta manera, aunque prácticamente ausente de las –frecuentemente bizantinas– discusiones entre los abogados del acceso abierto, RepNet ha sido por el contrario muy comentado y debatido por la comunidad de 'repository managers' en el Reino Unido, que es la encargada de implantar las a menudo cambiantes, cuando no contradictorias, políticas emanadas desde las distintas instancias administrativas a nivel institucional, regional o nacional.

Tal como se presenta en la página principal del proyecto, el desarrollo de servicios sobre la capa de repositorios se sustenta sobre un análisis previo de las necesidades de los diferentes actores implicados (instituciones, agencias de financiación, investigadores...) y sobre la definición de una serie de áreas de trabajo en las cuales es perentorio proporcionar nuevas funcionalidades para garantizar la continuidad de los repositorios de acceso abierto en un momento en el que las exigencias para cumplir con los requisitos de aportación de información científica que plantea el

Research Excellence Framework (REF) –el ejercicio de evaluación científica que se llevará a cabo en el Reino Unido en 2014– hacen que muchas instituciones hayan optado por adquirir e implantar sistemas CRIS que a menudo amenazan con reemplazar a los repositorios de acceso abierto, pese a basarse en un enfoque mucho más centrado en la gestión de información científica que en el acceso abierto como tal [4].

Las áreas de actividad de RepNet a nivel de identificación, diseño, desarrollo e implantación de servicios para repositorios son las siguientes:

1. Agregación de Contenidos. En este ámbito, RepNet propone la construcción de un

agregador de contenidos de toda la red de repositorios del país. A diferencia de muchos otros países en los que esta funcionalidad existe desde hace tiempo, en el Reino Unido no se ha consolidado ninguna de las diferentes iniciativas que han desarrollado prototipos para la agregación de contenidos. Esta desventaja a nivel de infraestructura tiene la contrapartida de que una plataforma contruida en este momento puede ofrecer funcionalidades mucho más avanzadas que las que poseen las plataformas desarrolladas con anterioridad, tales como la minería de datos sobre los textos completos de los documentos archivados con asignación automática de descriptores, la detección e integración de duplicados a partir de una estrategia similar de análisis del texto completo de los contenidos y la detección de registros

metadata-only (sin texto completo asociado) incluso aunque contengan un archivo PDF por defecto o

'default dummy file' para indicar que el texto completo no está disponible. Teniendo en cuenta que la adopción de las directrices DRIVER ha sido muy escasa en el Reino Unido (lo que ha llevado a su vez a niveles de cumplimiento inusitadamente bajos de los estándares de OpenAIRE), una agregación puede ofrecer una novedosa funcionalidad de validación de esquemas de metadatos, aplicando criterios muy avanzados como los de detección de las versiones de los articulos archivados o la agregación de información de financiación de los trabajos.

Workflow ITIL para la incubación de servicios en RepNet

2. Generación de Informes y Comparativa de Plataformas. En el area de

'reporting', RepNet viene operando el proyecto

IRUS-UK [5] siguiendo un modelo común de incubación de servicios externalizados de acuerdo con la metodología ITIL [6]. IRUS-UK es un proyecto desarrollado en el Centro de Datos MIMAS de la Universidad de Manchester para recolectar estadísticas de uso de múltiples repositorios armonizadas de acuerdo con el estándar COUNTER. A mediados de septiembre de 2013, IRUS-UK

recoge y agrega datos de 40 repositorios institucionales –lo que supone aproximadamente un tercio de la red nacional– y continúa extendiendo su cobertura, limitada por el momento a EPrints (29) y DSpace (11) en tanto el equipo de desarrollo trabaja en el módulo de intercambio de datos para Fedora y otras plataformas. Además de permitir la comparación para diferentes plataformas y tipos de documentos, el objetivo de IRUS-UK es obtener una estimación de las estadísticas de uso agregadas para toda la red, en la confianza de que los niveles de uso globales resultarán un argumento convincente para garantizar la utilización continuada de la misma por parte de autores e instituciones.

3. Deposito Automático de Contenidos. El proyecto

Repository Junction Broker (RJB) es una iniciativa desarrollada en el

EDINA National Data Centre para la transferencia automatizada de contenidos a la red de repositorios a través del protocolo SWORD. Después de varios años de trabajo, el proyecto RJB se incluyó como parte de los servicios a prestar por parte de RepNet, y ha sido bajo este paraguas cuando

ha comenzado a funcionar como servicio en fase piloto desde mediados de este año [7]. RJB pretende consolidar una base de proveedores de contenido, fundamentalmente a nivel de artículos de revista, que puedan ser distribuidos, bien como registros sólo de metadatos o como metadatos+texto completo, a los diversos repositorios institucionales correspondientes a las afiliaciones de los autores de cada artículo concreto. En un principio, el RJ Broker ha firmado acuerdos con el repositorio temático EuropePMC y con Nature Publishing Group para distribuir los contenidos de ambos proveedores como proyecto piloto (el primero de ellos según el modelo

'metadata-only' y el segundo transfiriendo

metadata+full-text, lo que requiere el compromiso expreso por parte de los repositorios receptores de no difundir los textos completos antes de la fecha de embargo). Un aspecto clave de la operación de este servicio es su naturaleza internacional por defecto: dado que los autores de los artículos son con frecuencia internacionales, basta con que los repositorios institucionales susceptibles de recibir información esten registrados con el servicio para que automáticamente puedan recibir los contenidos (previa instalación de SWORD) con independencia del país en el que esten ubicados.

Servicio RJB para la distribución automática de contenidos

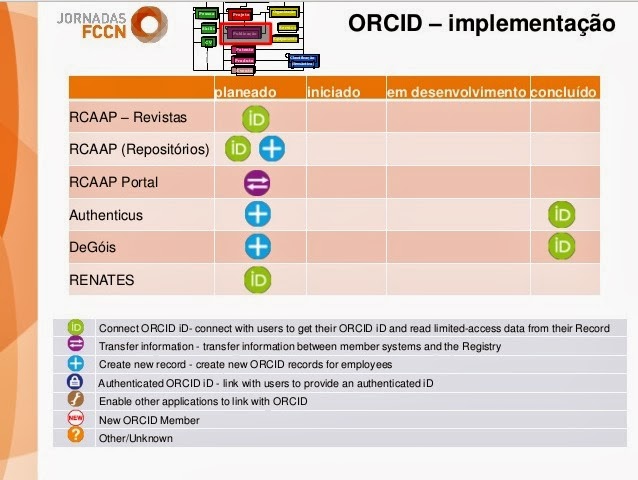

4. Enriquecimiento de Metadatos. El area de Metadata Enhancement es posiblemente la más amplia de las que aborda el proyecto RepNet. Fruto de las investigaciones previas sobre necesidades de los diferentes ámbitos implicados, se puso de manifiesto la existencia de estrategias para la asignación de metadatos puestas en práctica por repositorios aislados (por ejemplo en el ámbito de la preservación de contenidos) que no se difundían al resto de la red. Vista la necesidad de armonizar el desarollo de toda la red al compás, se puso en marcha la iniciativa

RIOXX [8] para el desarrollo e implantacion de un 'application profile' que permitiera la

incorporación conjunta de metadatos sobre financiación (algo que ya abordaba OpenAIRE para los proyectos FP7), sobre aspectos específicos relativos al acceso y sobre identificadores como ORCID. Las

iniciativas preliminares para la incorporación de estos metadatos avanzados a los repositorios han comenzado a difundirse recientemente [9] de modo que puedan gradualmente adoptarse de manera conjunta por parte de toda la red.

5. Registro de Repositorios. Los dos principales directorios de repositorios existentes en la actualidad,

OpenDOAR y

ROAR, mantenidos respectivamente por las universidades de Nottingham y Southampton, aportan una información más que aceptable sobre la red mundial de repositorios. Sin embargo, ninguno de ambos proporciona una cobertura completa de la red. Por este motivo, y también para actualizar el perfil que los directorios proporcionan sobre las plataformas que indexan, se ha puesto en marcha como parte de RepNet el proyecto Open Access Repository Registry (

OARR) [10]. Este proyecto pretende actualizar la informacion de OpenDOAR cubriendo en mayor detalle las características de los repositorios, en un momento en que tanto la implantación generalizada de sistemas CRIS como el creciente numero de repositorios de datos de investigación estan introduciendo cambios significativos en el sector. El nuevo directorio, cuyo proyecto lidera el equipo

CRC-SHERPA en la Universidad de Nottingham, se alojará eventualmente en los servidores de RepNet junto a otros servicios proporcionados por SHERPA tales como RoMEO, JULIET o más recientemente,

FACT. De hecho, una de las líneas para el diseño de nuevos servicios para repositorios pasa por explotar las sinergias entre estas aplicaciones gestionadas de manera integrada.

6. Localización de la Información. Una de las cuestiones más problemáticas de los repositorios hace referencia a la escasa visibilidad de sus contenidos en la red. Junto a la creación de esquemas de metadatos suficientemente comprensivos que puedan servir los propósitos de la

'discoverability', la línea de trabajo orientada a la mejora de la visibilidad de los contenidos pretende sobre todo optimizar los ratios de indexación de los materiales archivados en la red de repositorios del Reino Unido por parte de motores de búsqueda como Google Scholar o Microsoft Academic Search. Sea a través de la

identificación de buenas prácticas a nivel de repositorio individual o bien a través de la indexación masiva de una agregación de contenidos [11], es preciso mejorar la visibilidad de los contenidos de los repositorios en la red, así como identificar su procedencia de modo que el usuario final de la información pueda conocer y valorar la labor realizada desde estas plataformas.

7. Preservación/Continuidad de Acceso. Sin entrar directamente en el área de la preservación digital, cubierta por otros programas y proyectos del Jisc como

SPRUCE [12], el proyecto RepNet sí se planteó en cambio ofrecer alguna clase de servicio para la red de repositorios en el sentido de asegurar la continuidad de acceso a los contenidos archivados en la misma. Para ello, RepNet trabaja sobre la extensión a los materiales archivados en acceso abierto del modelo LOCKSS, ya empleado con éxito para la gestión de la continuidad en el acceso a materiales obtenidos a traves de suscripción por parte de las bibliotecas [13]. Este modelo se basa en el archivo periódico de los contenidos en una red de servidores distribuidos (las

'LOCKSS Boxes') gestionada por las instituciones.

Servicios de nueva creación

Además del énfasis en la integración y ulterior desarrollo de los servicios para repositorios ya existentes, el proyecto RepNet pretende también abordar el diseño, desarrollo e implantación de una serie de nuevos servicios. Para ello, RepNet adopta el modelo para la construcción de una infraestructura (de servicios) basada en datos o

'data-driven infrastructure' [14] que permita plantear la puesta en marcha de servicios de nueva creación largamente demandados por la comunidad, tales como herramientas para la monitorización del cumplimiento de mandatos de acceso abierto. La creación de nuevos servicios se lleva a cabo mediante el establecimiento de partnerships con instituciones concretas que permitan el ensayo y testeo de desarrollos piloto. Así, la iniciativa

STARS [15] llevada a cabo en colaboración con la Universidad de St Andrews y el Scottish Digital Library Consortium (

SDLC) se ha planteado como una prueba piloto para la implantación del conjunto de servicios que una iniciativa como RepNet puede ofrecer a una institución y un repositorio específicos.

Referencias

[1] La

Declaración de Berlín, publicada por la Sociedad Max Planck en octubre de 2003, puede considerarse razonablemente como el pistoletazo de salida del movimiento del acceso abierto con la opción que ofrecía a organismos académicos y de investigación para suscribirla de manera institucional. De hecho, la Semana de Acceso Abierto se celebra anualmente en el mes de octubre como conmemoración de la publicación de esta Declaración.

[2] Proyecto UK RepositoryNet+ (comúnmente conocido como "RepNet"),

http://repositorynet.ac.uk/

[3] Sólo el proyecto europeo

OpenAIRE plantea un nivel de objetivos de similar amplitud y ambición a los de RepNet a nivel de servicios a desarrollar sobre la red de repositorios de acceso abierto existente en la actualidad.

[4] En relación con el impacto sobre las instituciones del ejercicio de recopilación de información científica para el REF2014, véase la excelente presentación

'I am turning enterprisey' realizada por Chris Keene ('repository manager' en la Universidad de Sussex) en la reciente conferencia Repository Fringe 2013 celebrada en Edimburgo el pasado mes de agosto.

[5] Institutional Repository Usage Statistics (IRUS-UK),

http://irus.mimas.ac.uk/

[6] Ver referencia a ITIL en la sección de preguntas frecuentes de RepNet,

http://www.repositorynet.ac.uk/?q=content/faq

[7] “RJ Broker delivers its first test transfers”,

http://bit.ly/16dsJmq

[8] "RIOXX: Developing Repository Metadata Guidelines",

http://bit.ly/18hlzQW

[9] Nixon, W.J., Ashworth, S., and McCutcheon, V. (2013) “Enlighten: Research and APC funding workflows at the University of Glasgow”. Insights: the UKSG journal, 26 (2). pp. 159-167. ISSN 2048-7754 (doi:10.1629/2048-7754.80),

http://eprints.gla.ac.uk/83882/

[10] Open Access Repository Registry (OARR),

http://bit.ly/LeXGjp

[11] Kenning Arlitsch, Patrick S. O'Brien, (2012)

"Invisible institutional repositories: Addressing the low indexing ratios of IRs in Google Scholar", Library Hi Tech, Vol. 30 Iss: 1 pp. 60-81, DOI: 10.1108/07378831211213210

[12] Sustainable Preservation Using Community Engagement (SPRUCE),

http://bit.ly/1aXY1Vd

[13] UK LOCKSS Alliance Case Studies Now Available,

http://bit.ly/18Gkw9j

[14] Informe “Preparing for Data-driven Infrastructure”,

http://bit.ly/1a8SuXe

[15] Pablo de Castro, Jackie Proven, “The STARS Shared Initiative: Delivering Repository Services in an Advanced CRIS/IR Environment”. Presentación en el RepositoryFringe 2013,

http://slidesha.re/1eXH2nI